Appleは現地時間8月5日、子どもを性的虐待から守るための機能をiOS15やiPadOS15などに追加すると発表しました。性的内容のメッセージへの警告、既知の児童ポルノ画像などの検出機能などが含まれます。

子どもを性的虐待から守るために

米Appleは現地時間8月5日、「子どものための保護拡大(Expanded Protections for Children)」と題したページを公開し、今秋公開予定のiOS15、iPadOS15、macOS Monterey、watchOS8で追加する新機能を発表しました。

子どもを性的虐待から保護する目的で、3つの機能が新たに導入されます。これらの機能は、アメリカから導入され、順次拡大予定とのことです。

1. メッセージなどの保護

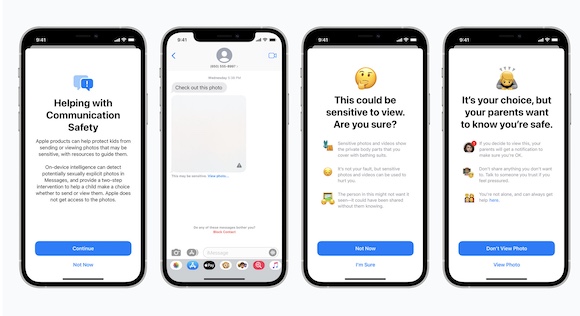

「メッセージ」アプリで、性的に問題のある画像を送信もしくは受信した場合に、子ども本人と保護者に警告し、画像にはぼかしが入ります。

ユーザーのプライバシー保護のため、問題のある画像の検出は、デバイス上での機械学習によって行われ、メッセージの内容をAppleが把握することはありません。

2. 性的虐待写真の検出

非営利団体の全米行方不明・被搾取児童センター(NCMEC)が把握している、児童への性的虐待(CSAM:Child Sexual Abuse Material)として報告された画像を検出します。

Appleは、ユーザーのプライバシー保護を重視すると強調し、画像のスキャンはクラウド上ではなくデバイス上で行われると説明しています。

AppleはPDFファイルで詳細な技術解説も公開しており、CSAMのデータベースにあるハッシュ(目印とある情報)と、デバイス上の画像が一致した場合にのみ、データがアップロードされ、NCMECに報告されると説明しています。

3. Siriと検索での検出

SiriやSpotlight検索で、児童保護につながる情報の提供が強化されます。

保護者が、児童への性的虐待などの問題に関する相談先などの情報が得られやすくなります。

Source:Apple via MacRumors

(hato)

- Original:https://iphone-mania.jp/news-387604/

- Source:iPhone Mania

- Author:iPhone Mania