ウェアラブル技術の進化により、時計や指輪などのさまざまなデバイスからバイタルデータを取得し、日々の暮らしに役立てられるようになりました。

株式会社ORPHEが開発するスマートフットウェアもその一つ。私たちの歩き方を詳細に解析して、ヘルスケアや医療の分野へと応用することが可能です。

そして同社は、ヘルスケアや医療の分野に、ゲームなどのエンタメ要素が融合した世界が実現すると見据えています。そんな世界が実現すると、私たちの暮らしはどう変わるでしょうか?同社の代表取締役CEOである菊川裕也さんに話を聞きました。

医療やヘルスケアに役立つ歩行データ

――まずはORPHE社の事業概要を教えてください。

菊川:私たちは「足元から世界を変える」ことをミッションに掲げ、センサーやコンピューターを内蔵した「スマートフットウェア」を開発しています。

センサーで取得するのは、歩行速度や歩幅、足の高さなど、「歩容」と呼ばれる歩行パターンに関する情報です。これらの情報を分析・可視化して、ランニング・ウォーキングフォームの解析や、医療現場でのリハビリなどに活用しています。

――取得した歩行パターンのデータを、それらの分野にどうやって活用するのでしょうか?

――取得した歩行パターンのデータを、それらの分野にどうやって活用するのでしょうか?

菊川:たとえば、医療分野向けに提供している「ORPHE ANALYTICS MEDICAL」を使えば、センサーを内蔵したシューズ、もしくは外付けのセンサーから取得したデータをもとに、6mから10m歩くだけですぐにレポートが生成されます。

歩くスピードや左右のバランスなど、さまざまなデータをスコア化して、リハビリや手術の前後で歩容がどう変わったかなど、定量的な評価を行うことが可能です。

電子楽器からシューズの世界へ

――もともと、ORPHEは電子楽器の開発からスタートしたと伺いました。

菊川:大学院時代にはHCI(Human-Computer Interaction)系の研究室に所属して、音楽演奏用インターフェースの研究を行っていました。当時は「音に合わせて動く、さわれる楽器」というコンセプトの電子楽器を開発していました。その後、在学中の2014年に、スマートフットウェア「ORPHE(当時の製品名は“Orphe”)」の製品化をきっかけに、現在の前進となる企業を設立しました。

――どういう経緯で楽器からシューズへと展開したのでしょうか?

菊川:音や光、動きなどの要素を内包できて、かつ誰もが日常的に身につけるものは何か、と考えた末、シューズにたどり着きました。フラメンコやタップダンスなど、シューズを楽器として使う例は多いですから、親和性が高いと考えたんです。

初代モデルの「ORPHE」も、履いた人の動きに合わせて電子音を発するもので、「動きを光や音に変換するスマートシューズ」がメインコンセプトでした。

2016年9月に一般販売を行った初代ORPHE(Orphe)。

菊川:履いた人の動きをリアルタイムにセンシングしてフィードバックを行う、という基本的な仕組みは当時から変わっていません。

じつは、初代モデルを開発した段階から、「このスマートシューズはスポーツや医療にも応用できる」と考えていました。当時は構想レベルのものでしたが、段階的に進化を重ねていき、現在に至ります。

リアルの歩行が、バーチャル空間につながる近未来

――ここからは、新しい領域の取り組みについて伺います。昨年5月には「リアルとバーチャルを行き来する」コンセプトのキャンペーンを実施しましたね。

菊川:昨年5月のキャンペーンは、「リアルで購入したシューズをバーチャルの中でも履いてもらおう」と考えて実施しました。VR空間プラットフォームのDecentraland(ディセントラランド)で使えるデジタルデータのNFTを、シューズの購入者に無料で贈呈するという試みで、現在も継続しています。

Decentralandで、ORPHEのスマートシューズを着用したアバター

菊川:リアルとバーチャルの双方で同じシューズを履く経験は、非常に新鮮で楽しいものでした。バーチャル空間で活動することが当たり前になれば、“空間の中をしっかり歩きたい”というニーズも高まるのではないでしょうか。

そうしたニーズが高まれば、シューズの見た目を変えるだけではなく、センサーで取得したリアルの動きをバーチャル側に送る、といった新しい使い方も生まれるだろうと考えています。

――“リアルの動きをバーチャルに送る”点では、今年の4月にスマートシューズを活用してゲームを作る取り組みを発表しましたよね?

菊川:はい、スマートシューズ用センサーの次世代機(ORPHE CORE3.0)を、センサー単体で販売開始したのに合わせて発表しました。

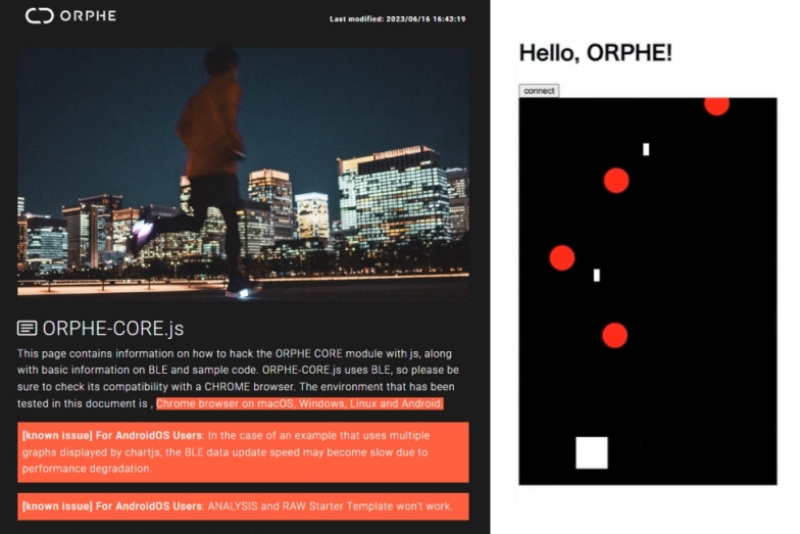

私たちは、誰でも活用しやすいオープンソースのライブラリ「ORPHE CORE.js」をGitHub上に公開しています。このセンサーとライブラリを活用すれば、センサーで解析した歩行・走行データを用いたwebアプリケーションや、センサーの動きと連動したオリジナルゲームを開発できるようになります。

グラフィックを極めて簡素化したサンプルですが、たとえば下記(右図)のように、センサーの動きに合わせたシューティングゲームなどが作れます。

「ORPHE CORE.js」のトップページ(左)と、簡易作成したゲーム画面のサンプル(右)

混ざりあう未来に生まれる行動変容とは?

――今後は医療やヘルスケアだけでなく、ゲーム分野にも注力する方針なんでしょうか?

菊川:医療やヘルスケアはもちろん、ゲームなどのエンタメ分野など、全ての領域に力を入れて取り組んでいきます。これらの分野から一つを選ぶというよりも、“混ざった状態”であることが大切だと考えています。

――混ざった状態、ですか?

菊川:医療やヘルスケアの分野でも、ゲーミフィケーションの必要性が論じられています。リハビリは「楽しくないと続かない」のが現実で、どうすれば日々の運動を習慣化して、楽しく続けることができるかは、重要なテーマなんです。

たとえば、散歩をしながらゲームができて、じつは健康管理にもなる。そんな近未来の姿を思い描いています。

――たしかに、ゲーム感覚でリハビリや運動ができるなら続けやすいかもしれませんね。

菊川:今までは、そうしたゲームを作ろうと考えても、専門的な知識や技能を持っていなければ難しかったと思います。しかし、先ほど述べたように、私たちのライブラリのオープンソースを使えば、プログラムの経験が浅い人でも、簡単にゲームを作ることも可能になります。

ちなみに、YouTubeで公開しているワークショップでも実践しているんですが、ゲームのプログラミングをChatGPTに書いてもらうことも可能なんですよ。

現時点でも、私たちが公開しているオープンソースとChatGPTを駆使すれば、ゲームを作ることはほぼ可能だと言えますが、今後はさらに、より高度なゲームを簡単に作れる環境が整っていくでしょう。

そうなれば、医師が「患者にこういう運動をさせたい」と考えて専用のゲームを作るとか、患者が「このトレーニングに飽きた」と思えば自分でアレンジできるとか、そんな世界が現実になると考えています。

(取材/文・和田 翔)

- Original:https://techable.jp/archives/220006

- Source:Techable(テッカブル) -海外・国内のネットベンチャー系ニュースサイト

- Author:はるか礒部

Amazonベストセラー

Now loading...