OpenAIの対話型AI“ChatGPT”が登場して早1年。昨今はさまざまな国で新たな生成AIが開発されているものの、いまだにChatGPTが完全独走の状態だ。

ところが、最近になって2023年に設立されたばかりの中国の生成AIスタートアップ“01.AI”の大規模言語モデル「Yi-34B」がChatGPTに迫る勢いでユーザー数を伸ばし続けている。

Google Chinaの元CEOが設立した01.AI

01.AI公式サイトより引用

01.AI公式サイトより引用

同社の使命は、LLMによって人間の生産性を向上させ、経済や社会に大きな変化をもたらす「AI 2.0時代」に貢献することだ。多くのAI企業が“人間を超えるAIの能力”をアピールするなか、あくまでも“人”を基盤にした「Human+AI」をモットーとしている。

中国発・オープンソースの大規模言語モデル「Yi-34B」

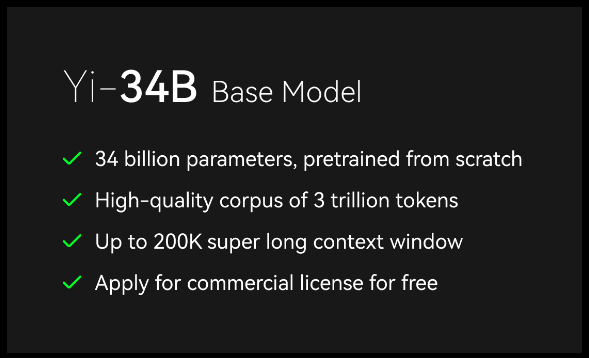

そんな01.AIが提供している生成AIがYi-34Bだ。同モデルはゼロからトレーニングされたオープンソース型の大規模言語モデル。英語・中国語に対応しており、個人・学術・商用(とくに中小企業)の目的に適しているという。

01.AI公式サイトより引用

LLaMAと同じTransformer構造を採用することで、Yi-34BはLLaMA エコシステム内の既存のツール、ライブラリ、リソースを活用することが可能に。新しいツールを作成する必要がなくなり、開発効率が向上する。

より多様な応答を生成するチャットモデル

Yi-34Bのチャットモデルは、Supervised Fine-Tuning(SFT)を使用した専用のトレーニングを受けている。ほかの標準的なチャットモデルと比較して、より多様な応答を生成するため、クリエイティブ・シナリオなどのさまざまなタスクで役立つだろう。

さらに、この多様性により高品質の応答が生成される可能性が高まり、その後の強化学習トレーニングが有利になると期待されている。

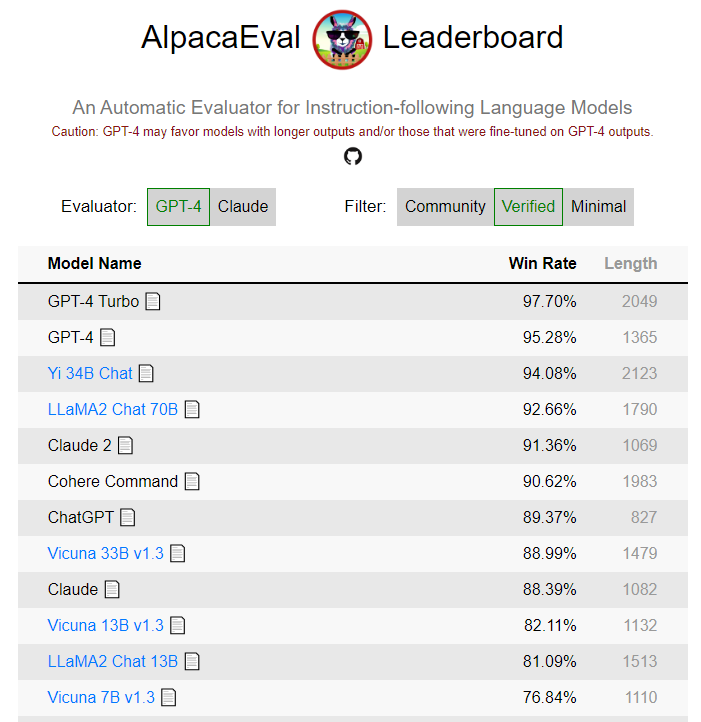

評価サイトで「Yi-34B」がChatGPTの次にランクイン

AlpecaEvalより引用

トップを走るChatGPTはパラメーター数3550億、競合となるFalcon-180Bがパラメーター1800億、LlaMa2‐70Bが700億だが、Yi-34Bは340億である。

ほかの言語モデルよりもバロメータ数が少ないものの、2023年10月には中国の言語モデルのベンチマークサイトSuperCLUEで、Yi-34B(中国語機能)がBaidu ERNIE、Qwen、Baichuanなどを上回り、GPT-4に次いで2位にランクイン。

その後12月には、言語モデルのベンチマークサイトAlpecaEvalで、Yi-34B(英語機能)は競合を追い抜きChatGPTの次にランクインした。

どうやら、パラメーター数が多ければいいというわけではないらしい。ちなみに、NVIDIAのサイトからYi-34Bのお試し版が利用可能だ。英語と中国語がメインだが、日本語でも答えてくれた。気になる方は試しみてはいかがだろう。

今回のYi-34Bのように、ChatGPTの地位を脅かすAIは度々登場している。たとえば、中国科学院・清華大学研究者らが開発した“Xwin-LM”もその1つだ。

中国のLLM系の生成AIは現在130もあり、世界全体の40%を占めるという。米国が世界シェア50%でリードするなか、今後もますます熾烈な戦いが予想されている。

参考・引用元:01.AI公式サイト

(文:MI001YOU)

- Original:https://techable.jp/archives/226147

- Source:Techable(テッカブル) -海外テックニュースメディア

- Author:Haruka Isobe

Amazonベストセラー

Now loading...